Resumen

Resumen

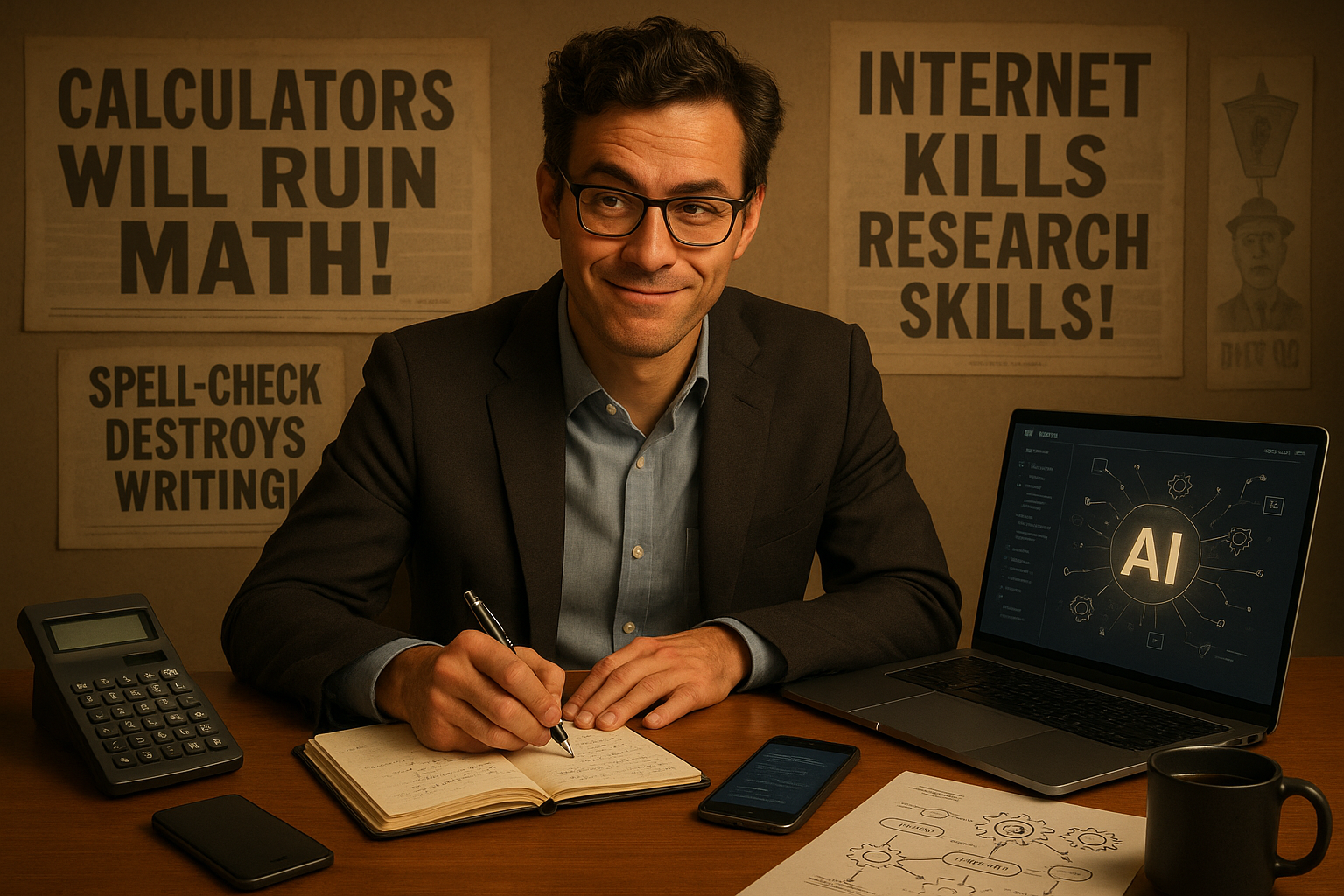

Las herramientas de IA no hacen trampa, sino que la gente hace trampa. Tenemos el mismo pánico moral sobre la IA que teníamos sobre las calculadoras, los correctores ortográficos e internet, y es tan ridículo ahora como lo era entonces.

La IA se convierte en "tramposa" cuando: la usas para evadir el aprendizaje, omitir por completo el pensamiento o fingir ser más inteligente de lo que realmente eres. Básicamente, cuando intentas obtener reconocimiento por un trabajo que no hiciste o por conocimientos que no tienes.

La IA funciona perfectamente cuando: la usas para potenciar tu pensamiento, superar barreras y crear un mejor trabajo mediante la colaboración entre humanos e IA. El secreto está en que sigues entendiendo, evaluando y asumiendo el control del resultado final.

Cuatro preguntas para comprobar la realidad: ¿Qué se supone que debes lograr realmente? ¿Mientes sobre la función de la IA? ¿Tu cerebro interactuó con el resultado? ¿Coincide esto con lo que la gente espera en tu situación?

En resumen: El futuro pertenece a quienes dominan la colaboración humano-IA, manteniendo a la vez un pensamiento crítico agudo. Deja de preocuparte por la herramienta y empieza a usarla como un profesional.

Permítanme comenzar con algo que debería ser obvio, pero que, por alguna razón, no lo es: las herramientas de IA no hacen trampa. Las personas hacen trampa. Las herramientas son solo herramientas, y perder la cabeza por esta distinción es como culpar a los martillos por los clavos torcidos.

Después de trabajar con herramientas de automatización e IA, veo esta histeria de "¿hace trampa la IA?" con la misma frustración que sentí al ver a la gente entrar en pánico por las calculadoras, los correctores ortográficos e internet. Nunca aprendemos, ¿verdad?

Esto es lo que realmente ocurre: usar IA se convierte en trampa cuando se usa para evitar por completo pensar, aprender o hacer el trabajo que se supone que se debe hacer. Pero ¿usar IA para pensar mejor, aprender más rápido o producir trabajo de mayor calidad? A eso se le llama "no ser un idiota con los recursos disponibles".

Ya hemos estado aquí antes (y todavía somos pésimos aprendiendo de la historia)

Cuando las calculadoras aparecieron en las aulas en la década de 1970, los educadores perdieron la cabeza por completo. "¡Los estudiantes no aprenderán matemáticas básicas!", gritaban. Cuando los correctores ortográficos se convirtieron en estándar, los críticos predijeron la muerte de la escritura correcta. Cuando internet hizo accesible la información, la gente estaba convencida de que destruiría las habilidades de investigación.

Esto es lo que realmente ocurrió cada vez: descubrimos cómo usar estas herramientas apropiadamente, nos hicieron mucho más capaces y las predicciones apocalípticas resultaron ser un completo disparate.

He creado sistemas de automatización que gestionan tareas rutinarias tediosas para que las personas puedan centrarse en la resolución creativa de problemas. Nadie lo llama "hacer trampa", sino "eficiencia brillante". El mismo principio se aplica a la IA, pero de alguna manera nos hemos convencido de que esta vez es diferente.

No es diferente. Solo estamos siendo dramáticos otra vez.

Cómo diferenciar entre usar IA y ser un estafador perezoso

Tras años desarrollando sistemas de automatización basados en IA, he desarrollado un marco infalible. Cuatro preguntas extremadamente sencillas:

¿Qué se supone que realmente estás logrando aquí?

Si el objetivo es aprender algo o demostrar tu comprensión, usar la IA para eludir ese aprendizaje es, obviamente, hacer trampa. Si estás resolviendo un problema real o realizando un trabajo legítimo de forma eficiente, la IA es solo una herramienta más.

Prueba sencilla: ¿Puedes explicar y defender el resultado generado por la IA como si realmente lo entendieras? Si no, estás usando la IA como una muleta, no como una herramienta.

¿Estás siendo honesto acerca de lo que realmente sucedió?

No mientas sobre tu proceso. Si la IA jugó un papel importante, reconócelo cuando sea relevante. He visto a gente hacer pasar el trabajo generado por IA como si fuera una idea brillante; en cuanto alguien hace preguntas de seguimiento, se les expone completamente como fraudes.

¿Su cerebro realmente se involucró con la salida?

Los resultados de la IA suelen parecer plausibles, pero son erróneos o inapropiados en el contexto. Si no evalúas y refinas críticamente el contenido de la IA, simplemente estás siendo un canal descuidado para información potencialmente basura.

Utilizo herramientas de IA constantemente, pero nunca acepto sus resultados sin verificarlos. Las decisiones finales y el control de calidad siempre son míos.

¿Esto coincide con lo que la gente espera en su situación?

Cada contexto tiene estándares diferentes. Lo que es adecuado para propuestas comerciales puede ser inapropiado para trabajos académicos. Esto requiere conocimientos profesionales básicos, no un título en filosofía.

Ejemplos reales: Uso inteligente vs. engaño

Trampa académica: un estudiante le pide a ChatGPT que escriba un ensayo completo y lo presenta como trabajo original.

Legitimidad académica: el estudiante usa IA para generar argumentos y obtener retroalimentación, luego desarrolla ideas con su propio análisis.

Estupidez profesional: utilizar IA para generar informes de clientes sin comprender el análisis ni poder responder preguntas.

Competencia profesional: utilizar IA para redactar propuestas y luego aplicar su experiencia para refinar y validar los resultados.

La diferencia es si el ser humano realmente se involucró con el material y contribuyó con un trabajo significativo.

Lo que esto significa para el futuro

Para educadores

Dejen de intentar prohibir la IA (imposible e irresponsable) y rediseñen las evaluaciones para enfatizar las habilidades que le faltan: pensamiento crítico, creatividad y juicio complejo. Los educadores inteligentes ahora enseñan a los estudiantes a usar la IA eficazmente en lugar de fingir que no existe.

Para profesionales

Desarrollar políticas claras centradas en los resultados y la rendición de cuentas, no en el miedo tecnológico. Asegurarse de que la IA mejore el juicio humano en lugar de reemplazarlo. Capacitar al personal en el uso responsable y mantener la responsabilidad humana en las decisiones.

Para todos

Aprenda a colaborar con la IA manteniendo el pensamiento crítico. Quienes eviten la IA se quedarán atrás. Quienes dependan de ella acríticamente producirán basura. Quienes dominen la colaboración reflexiva obtendrán enormes ventajas.

En resumen: deja de pensar demasiado en esto

La cuestión ética no es si se utiliza IA, sino si se utiliza de forma responsable y honesta.

La IA se vuelve "tramposa" cuando se usa para evitar aprender o pensar. Se vuelve legítima cuando se usa para mejorar las capacidades mediante una colaboración genuina entre humanos e IA.

Llevo años usando herramientas de IA: son increíblemente poderosas cuando se usan con cuidado y potencialmente desastrosas si se usan sin cuidado. La diferencia no es la herramienta, sino la inteligencia y la integridad del ser humano que la usa.

El objetivo debería ser convertirnos en humanos más capaces que aprovechen la IA de manera efectiva, no en luditas con fobia a la IA o en zombis dependientes de la IA que no pueden pensar sin asistencia algorítmica.

Si no puede distinguir entre usar una herramienta para mejorar su trabajo y evitarlo por completo, el problema no es la IA, sino una falta fundamental de criterio profesional que sería problemática independientemente de la tecnología disponible.

Así que dejemos de debates histéricos y empecemos a usar estas herramientas con responsabilidad. El futuro llegará, estemos preparados o no.

PD: No usé IA para escribir este artículo desde cero, pero sí la usé para ayudarme con el corrector ortográfico y los motores de búsqueda. Si eso te preocupa, el problema no es mi proceso, sino tu comprensión de cómo se realiza realmente el trabajo profesional.