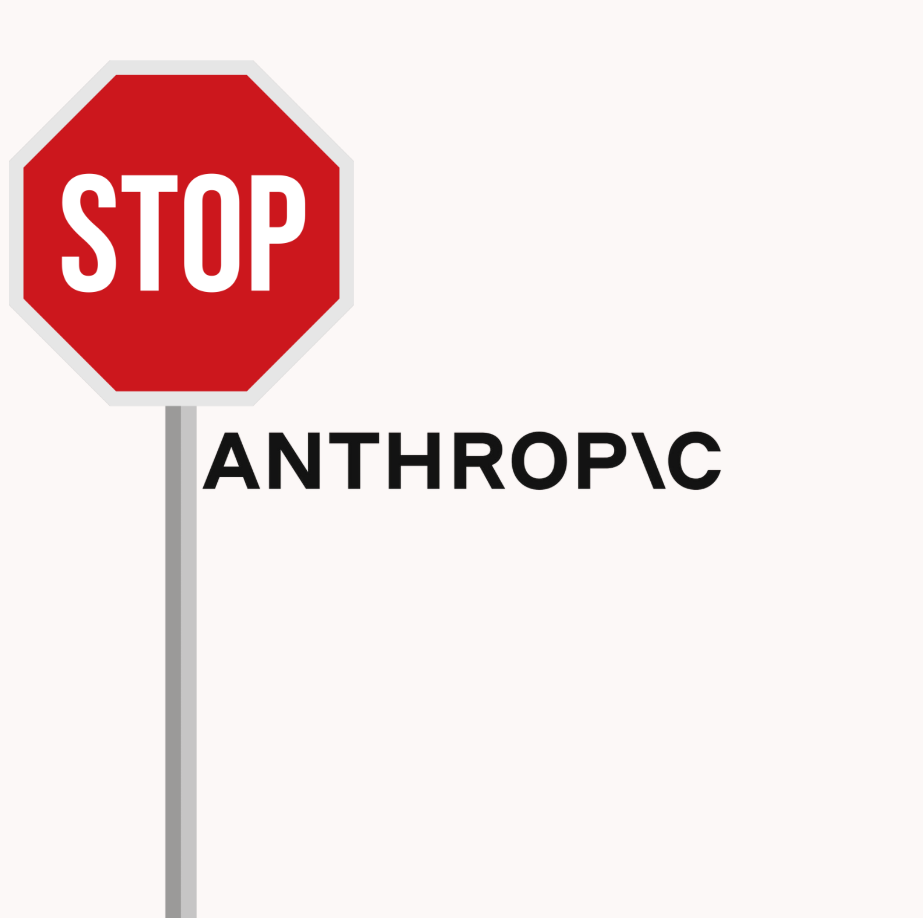

אנתרופיק חסמה את OpenAI מלהשתמש בממשק ה-API של קלוד - כולל קוד קלוד.

מַדוּעַ?

כי הם מאמינים ש-OpenAI הפרה את החוקים.

ל-OpenAI הייתה גישה ל-Claude והיא השתמשה בו בכלי הבדיקה הפנימיים שלה.

הם השוו את קלוד למודלים שלהם - אולי אפילו השתמשו בו כדי לשפר את GPT-5.

אנתרופיק לא אהב את זה.

התנאים שלהם אומרים שאי אפשר להשתמש בקלוד כדי לבנות או לאמן מודל מתחרה.

אז הם ניתקו את OpenAI.

רגע לפני ש-GPT‑5 עומד להשיק .

מה אומרות החברות

אנתרופיק טוען ש-OpenAI הפרה את הכללים.

הם לא מאפשרים לאנשים להשתמש בקלוד כדי לאמן או לשפר מודלים מתחרים - במיוחד לא בקנה מידה כזה.

הם אמרו:

"אנחנו בסדר עם השוואות אגביות. אבל להשתמש בקלוד כדי לשפר את המודל שלך? זה אסור."

OpenAI לא מרוצה.

הם אמרו שהם "מאוכזבים" וציינו כי לאנתרופיק עדיין יש גישה לממשק ה-API של OpenAI.

הם גם אמרו:

"השוואת מתחרים היא נוהג מקובל."

אבל הם לא אמרו אם הם באמת השתמשו בקלוד כדי לאמן את GPT-5.

מה זה אומר (במילים אנושיות)

ל-OpenAI הייתה גישה ל-API של קלוד.

הם חיברו אותו לכלים הפנימיים שלהם ובדקו אותו לצד המודלים שלהם - כנראה כדי לראות איך קלוד מטפל בדברים כמו קוד, הנחיות בטיחות והיגיון.

אנתרופיק ראה בכך חציית גבול.

התנאים שלהם אומרים שאי אפשר להשתמש בקלוד כדי לבנות או לאמן מודל מתחרה.

אז הם סגרו את הדלת.

זה לא רק OpenAI לעומת Anthropic.

אם אתם נותנים גישת API לתוכנה שלכם - זה משנה.

אתה סומך על אנשים לא רק שישתמשו בזה, אלא שלא ילמדו מזה בדרכים שיפגעו בך.

חיבור הנקודות

האם זה בכלל חדשות?

בואו נבחן את העובדות.

מה בעצם נאמר בתנאים וההגבלות של אנתרופיק?

על פי תנאי השירות המסחריים של Anthropic, לקוחות אינם רשאים:

"להשתמש בשירותים כדי לבנות מוצר או שירות מתחרה, כולל לאמן מודלים מתחרים של בינה מלאכותית."

"הנדסה הפוכה או שכפול השירותים."

סעיף זה הוא הסיבה לכך שאנתרופיק טוענת שהם ביטלו את גישת ה-API של OpenAI.

מקור: WIRED – יולי 2025

מה המטרה של מתן גישה ל-API של מישהו?

ממשק API (Application Programming Interface) מאפשר למוצרים או שירותים אחרים לתקשר עם מודל בקנה מידה גדול - באמצעות אוטומציה.

כאשר חברות נותנות גישת API, זה בדרך כלל:

להטמעת הבינה המלאכותית בכלים, אפליקציות או זרימות עבודה

להריץ משימות בקנה מידה גדול כמו סיכום, קידוד או סיווג

כדי לאפשר למפתחים לבדוק ולבנות תכונות חדשות באמצעות יכולות מודל הבינה המלאכותית

השימוש ב-API כמעט אף פעם לא ידני. משמעות הדבר היא גישה בכמות גדולה, שימוש חוזר ובדרך כלל אוטומציה - וזו בדיוק הסיבה שחברות קובעות כללים לגבי אופן השימוש בו.

האם אנתרופיק ידעה ש-OpenAI משתמשת ב-API שלה?

כן - וכל הסימנים מצביעים על כך שמדובר במהלך מחושב, לא בהפתעה.

OpenAI הייתה צריכה להירשם לגישה של קלוד ל-API, מה שאומר ש-Anthropic העניקה אותה ביודעין. השימוש ב-API ניתן למעקב, וספקים כמו Anthropic עוקבים אחר מי קורא למודלים שלהם וכיצד.

העובדה שהביטול הזה התרחש ממש לפני השקת GPT-5, לפי השמועות, ופורסם - מרמזת על אסטרטגיה, לא על תאונה. אנתרופיק גם ציינה הפרה של תנאי השירות שלהם, מה שמרמז שזו לא הייתה הדאגה הראשונה שהועלתה.

אז בעוד שההצהרה הפומבית גרמה לזה להישמע כמו אכיפה, סביר יותר שזה היה קו מכוון ששורט בחול - בתנאיה של אנתרופיק, ברגע שבחרו.

שורה תחתונה

חברת Anthropic ביטלה את גישת ה-API של OpenAI ל-Claude בתחילת אוגוסט 2025.

הסיבה שניתנה: הפרת תנאי השירות של אנתרופיק.

מהלך זה התרחש זמן קצר לפני השקת GPT-5 הצפויה של OpenAI.

OpenAI האשימה בעבר מודלים אחרים, כמו DeepSeek , באימונים על התפוקות שלה - דאגה גוברת במרוץ הבינה המלאכותית.

גישת API מוענקת ביודעין; השימוש ניתן למעקב.

אנתרופיק פרסם את הביטול הזה בפומבי, דבר המצביע על החלטה אסטרטגית.

הצע את זה

אם האפליקציה שלך מספקת API, שאל את ה-LLM שלך:

"תנו לי רעיונות לגילוי שימוש לרעה אפשרי ב-API שלנו - במיוחד על ידי מתחרים או משתמשים שמגיעים לכמויות גדולות."

אילו דפוסים ביומנים, פעילות אימות או תעבורה יכולים לאותת על משהו חריג?

זה לא יעצור שימוש לרעה בפני עצמו,

אבל זה יכול לעזור לך לזהות את זה מוקדם - ולפעול מהר.

פרספקטיבה של צוות האור הקפוא

אלו לא חדשות. אלו אסטרטגיה.

ואנחנו הולכים לזרוק שם תיאוריית קונספירציה.

נראה ש-Anthropic ידעו ש-OpenAI משתמשת ב-API שלהם - או שהם לא רוצים להודות שלא.

כי לומר "לא שמנו לב" ייראה רע.

אבל הם גם לא אומרים "לא ידענו". השתיקה הזאת אומרת משהו.

ועכשיו, ממש לפני שצ'אטGPT-5 צפוי לצאת לדרך, הם מפרסמים פרסום של "הפרת תנאים"?

בעוד ש-OpenAI טוענת שזו הייתה רק גישה סטנדרטית?

מרגיש כאילו אנתרופיק מכין את הגלשן לפני שגל GPT-5 יגיע.

אם ChatGPT-5 בסופו של דבר יהיה כל מה שהוא טוען להיות, אתם כבר יודעים לאן השמועות יגיעו:

התאמנת על קלוד?

קוד שנבנה באמצעות המודלים של אנתרופיק?

אז עוד לפני שהרכיבה הזו מתחילה, אנתרופיק חותר החוצה ונוהל דגל.

בכנות? זו אסטרטגיה חכמה.

וההיגיון מאחורי התיאוריה שלנו הוא פשוט:

אם היינו רואים מתחרה שמתעסק עם אלכס שלנו באמצעות API, לא היינו נותנים לו שנייה.

היינו חוסמים אותם - בלי לשאול שאלות.

אז העובדה שאנתרופיק לא עשתה זאת?

כן... מוזר.