Anthropic vient de lancer Claude 4 — non pas un seul modèle, mais une gamme complète. Vous trouverez Opus (le poids lourd), Sonnet (le nouveau modèle par défaut) et Haiku (léger et rapide).

Ce n'est pas un lancement publicitaire, mais un lancement structurel.

Ils déploient des outils, de la mémoire, des couches de sécurité et une direction claire : une IA qui apparaît, reste et aide réellement.

Ce que dit l'entreprise

Anthropic affirme que Claude 4 est conçu pour gérer davantage de tâches, davantage d'étapes, davantage de complexité, avec davantage de contrôle.

Il peut gérer des processus plus longs

Claude Opus a été testé sur des tâches de codage qui ont duré sept heures d'affilée.Il fonctionne sous des mesures de sécurité renforcées

Opus 4 fonctionne selon la norme ASL-3 : la norme interne d'Anthropic qui couvre la résistance au jailbreak, la cybersécurité et la surveillance des risques.Il est fait pour le vrai travail

Avec des outils, de la mémoire et des API, il est structuré pour une utilisation pratique, pas pour le jeu.

Le PDG Dario Amodei a décrit la sortie de Sonnet comme étant retardée par des « progrès significatifs ».

Ce que cela signifie (en termes humains)

Claude 4 ne cherche pas à devenir votre ami chatbot. Il est conçu pour gérer davantage de tâches : pas seulement des réponses intelligentes, mais aussi du travail concret.

Voici à quoi cela ressemble :

Il utilise des outils : il peut prendre des fichiers, rechercher des éléments et appeler des fonctions pour effectuer des tâches réelles

Il contient plus de contexte — pas seulement des réponses ponctuelles, mais de longues chaînes de raisonnement

Il suit des éléments tels que votre ton, vos objectifs et les éléments sur lesquels vous travaillez.

Il reste stable — vous n'avez donc pas besoin de tout recommencer lorsque quelque chose devient complexe

Cette mise à jour porte moins sur ce que Claude dit que sur ce que Claude est désormais prêt à faire.

Relions les points

Concentrons-nous sur ce qui compte réellement dans cette nouvelle version : les éléments qui rendent Claude 4 plus utilisable et plus fiable dans le travail quotidien.

🧠 Il peut contenir du contexte (sans le rendre étrange)

Claude 4 prend désormais en charge :

Jusqu'à 200 000 jetons d'entrée (~ 500 pages)

Opus produit jusqu'à 32 000 jetons ; Sonnet peut atteindre 64 000

Mémoire qui enregistre votre nom, vos préférences, votre ton d'écriture et vos tâches antérieures

Un onglet Mémoire visible où vous pouvez l'afficher, le modifier ou le supprimer

Il ne s'agit pas d'une IA personnelle. Il s'agit plutôt d'une IA pratique, capable de transmettre discrètement le contexte sans vous demander de répéter.

Claude 4 vs. ChatGPT : comparaison de la mémoire et du contexte

Fonctionnalité | Claude 4 (Opus & Sonnet) | ChatGPT (GPT-4-turbo) |

Fenêtre contextuelle | Jusqu'à 200 000 jetons | Jusqu'à 128 000 jetons |

Longueur de sortie | Opus : 32 000 jetons Sonnet : 64 000 | Jusqu'à 4 096 jetons |

Disponibilité de la mémoire | Activé par défaut dans Opus & Sonnet | Disponible uniquement dans GPT-4 (payant) |

Ce qu'il suit | Nom, ton, préférences, fichiers/tâches passés | Nom, préférences, objectifs connus |

Contrôles de la mémoire | Onglet Mémoire complète pour modifier/supprimer à tout moment | Trouvé dans les paramètres du compte (moins visible) |

Accès gratuit au plan | Oui (Sonnet) | Pas de mémoire dans le niveau gratuit (3.5 uniquement) |

Positionnement | Encadré comme support d'outil | Présenté comme une commodité pour l'utilisateur |

🔒 Il est livré avec des limites intégrées — par limites, nous entendons la sécurité

Claude Opus 4 fonctionne au niveau de sécurité IA 3 — le propre benchmark interne d'Anthropic.

Voici ce que cela comprend réellement :

Équipe rouge (à l'intérieur et à l'extérieur)

Formation et filtres anti-jailbreak

Cyberprotections pour l'utilisation des outils et des fichiers

Surveillance des préjugés, des préjudices ou des comportements douteux

Mises à jour promises et rapports de transparence

Ce n'est pas une certification mondiale, mais c'est une ligne claire qu'ils se fixent et qu'ils respectent.

Sécurité et sûreté de l'IA : Claude 4 contre le terrain

Fournisseur | Modèle | Cadre de sécurité | Mesures clés | Remarques |

Anthropique | Claude Opus 4 | Niveau de sécurité 3 de l'IA | Red-teaming, filtres de jailbreak, cybersécurité, suivi des risques | Auto-déclaré, comprend un examen externe et un suivi |

OpenAI | GPT-4 | Mesures de protection internes | RLHF, modération, API cryptées, SOC 2 | Aucune échelle de sécurité publique ; se concentre sur les produits nocifs |

Gémeaux | Cadre de risque interne | Tests de biais, filtres d'outils, vérifications des faits, évaluations contradictoires | Équipes de sécurité intégrées avant le lancement | |

Méta | LLaMA 3 | Outils Purple Llama | Llama Guard, Prompt Guard, Pare-feu | Open source ; la sécurité est contrôlée par le développeur |

Mistral | Modèles Mistral | API de modération | Filtres de langue, mode sans échec, cryptage | Personnalisable ; moins de paramètres par défaut, plus ouvert par conception |

En résumé

Nouveautés : Claude Opus (avancé), Sonnet (par défaut), Haiku (léger)

Utilisez-le ici :

Web, API et application iOS disponiblesUtilisation de l'outil : Téléchargements de fichiers, fonctions et récupération — intégrés

Mémoire : active en Opus et Sonnet, modifiable à tout moment

Fenêtre de contexte : jusqu'à 200 000 jetons

Niveau de sécurité : Opus fonctionne au niveau ASL-3 d'Anthropic

Tarifs de l'API :

Opus : environ 15 $ d'entrée / environ 75 $ de sortie par million de jetons

Sonnet : environ 3 $ de rentrées / environ 15 $ de sortiesNiveau gratuit : Oui — Claude Sonnet

- En savoir plus

Cette version n'a pas pour but d'être tape-à-l'œil. Il s'agit de donner à l'IA la structure nécessaire pour réellement l'aider.

Point de vue de l'équipe Frozen Light

Claude vient de sortir une nouvelle sortie.

Et il est rempli de tous les mots que nous avons déjà entendus.

Raisonnement. Conçu pour le code. Conçu pour les tâches.

Et bien sûr, une nouvelle attention portée à la sécurité.

Mais c'est leur propre version interne de ce que signifie « sécurisé ».

Et apparemment, ils sont à la hauteur de cette norme.

(Remarque : si vous avez écrit la norme et que vous ne l’avez pas respectée, ce serait la vraie histoire.)

Alors, comment y donner un sens ?

Vous regardez l'entreprise.

Parce que les entreprises existent pour générer des revenus grâce à la valeur.

Et la vraie question est :

La valeur qu’ils créent correspond-elle réellement à vos besoins ?

Si vous avez besoin de contexte, voici ce qui s’est passé d’autre cette semaine :

Chez Frozen Light, nous avons écrit sur :

Google Build — où Gemini s'est connecté à Gmail, aux téléphones, à la génération de vidéos et à tout ce qu'ils pouvaient

Une nouvelle liste de prix est disponible dans l'écosystème de Google

OpenAI acquiert une société de matériel informatique : étendre les modèles à la façon dont nous interagissons avec eux

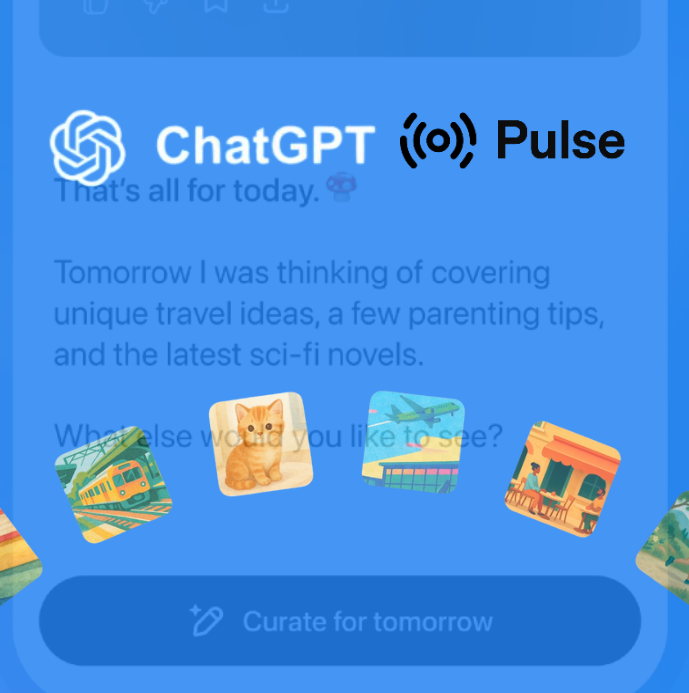

OpenAI évolue également rapidement sur les plugins Spotify, les intégrations d'espaces de travail et plus encore

Cela dresse un tableau.

Si vous êtes une entreprise LLM avec une plateforme, une distribution et des utilisateurs, vous êtes déjà intégré.

Vous construisez de l'intérieur. Vous faites partie du flux de travail des gens.

Claude n'a pas ça.

Ils doivent donc être les meilleurs.

Mais le meilleur dans quoi ?

À l’heure actuelle, la réponse ressemble à ceci :

Soyez le LLM sûr.

Plus sécurisé.

Plus structuré.

Et créer le type d’expérience dont ils pensent que les utilisateurs de l’IA ont besoin maintenant.

Et c'est pourquoi la nouvelle mise à niveau de Claude est importante —

parce qu’ils ont dû construire leur propre réglementation et s’y conformer (clin d’œil, clin d’œil).

Mais bon, c'est toujours leur histoire à raconter, même s'ils la construisent au fur et à mesure.

En fin de compte, le meilleur conseil que nous puissions vous donner est le suivant :

Vérifiez ce dont vous avez réellement besoin et voyez si l’orientation commerciale de Claude, qui indique clairement ses objectifs à long terme, correspond aux vôtres.

Et oui, habituez-vous à l’idée que vous pourriez avoir besoin de plus d’un LLM.

Il ne s’agit pas d’une opposition entre les deux.

La question est : de quoi ai-je besoin et qui peut réellement me le fournir ?